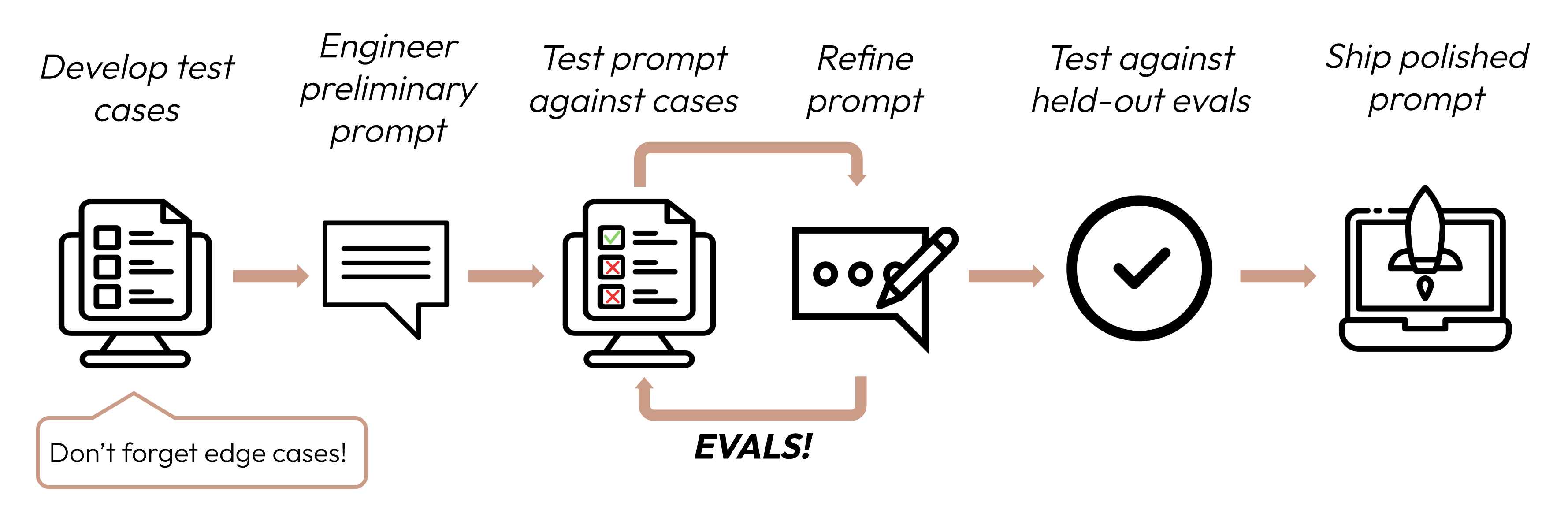

Der Aufbau einer erfolgreichen LLM-basierten Anwendung beginnt damit, dass Sie Ihre Erfolgskriterien klar definieren und dann Evaluierungen entwerfen, um die Leistung anhand dieser Kriterien zu messen. Dieser Zyklus ist zentral für Prompt Engineering.

Definieren Sie Ihre Erfolgskriterien

Gute Erfolgskriterien sind:

-

Spezifisch: Definieren Sie klar, was Sie erreichen möchten. Statt „gute Leistung" geben Sie an „genaue Stimmungsklassifizierung".

-

Messbar: Verwenden Sie quantitative Metriken oder gut definierte qualitative Skalen. Zahlen bieten Klarheit und Skalierbarkeit, aber qualitative Maßnahmen können wertvoll sein, wenn sie konsistent angewendet werden zusammen mit quantitativen Maßnahmen.

- Selbst „verschwommene" Themen wie Ethik und Sicherheit können quantifiziert werden:

Sicherheitskriterien Schlecht Sichere Ausgaben Gut Weniger als 0,1% der Ausgaben von 10.000 Versuchen, die von unserem Content-Filter als toxisch gekennzeichnet werden.

- Selbst „verschwommene" Themen wie Ethik und Sicherheit können quantifiziert werden:

-

Erreichbar: Basieren Sie Ihre Ziele auf Branchenbenchmarks, vorherigen Experimenten, KI-Forschung oder Expertenwissen. Ihre Erfolgskennzahlen sollten nicht unrealistisch für die aktuellen Fähigkeiten von Frontier-Modellen sein.

-

Relevant: Richten Sie Ihre Kriterien nach dem Zweck Ihrer Anwendung und den Bedürfnissen der Benutzer aus. Starke Zitiergenauigkeit könnte für medizinische Apps kritisch sein, aber weniger für beiläufige Chatbots.

Häufige Erfolgskriterien

Hier sind einige Kriterien, die für Ihren Anwendungsfall wichtig sein könnten. Diese Liste ist nicht vollständig.

Die meisten Anwendungsfälle erfordern eine mehrdimensionale Evaluierung nach mehreren Erfolgskriterien.

Erstellen Sie Evaluierungen

Evaluierungsdesign-Prinzipien

- Seien Sie aufgabenspezifisch: Entwerfen Sie Evaluierungen, die Ihre reale Aufgabenverteilung widerspiegeln. Vergessen Sie nicht, Grenzfälle einzubeziehen!

- Automatisieren Sie, wenn möglich: Strukturieren Sie Fragen so, dass sie automatische Bewertung ermöglichen (z. B. Multiple Choice, String-Abgleich, Code-Bewertung, LLM-Bewertung).

- Priorisieren Sie Volumen vor Qualität: Mehr Fragen mit etwas niedrigerem Signal automatisierter Bewertung ist besser als weniger Fragen mit hochqualitativer manueller Bewertung.

Beispiel-Evaluierungen

Bewerten Sie Ihre Evaluierungen

Wählen Sie bei der Entscheidung, welche Methode zum Bewerten von Evaluierungen verwendet werden soll, die schnellste, zuverlässigste und skalierbarste Methode:

-

Code-basierte Bewertung: Am schnellsten und zuverlässigsten, äußerst skalierbar, aber auch mangelnde Nuance für komplexere Urteile, die weniger regelbasierte Starrheit erfordern.

- Exact Match:

output == golden_answer - String Match:

key_phrase in output

- Exact Match:

-

Menschliche Bewertung: Am flexibelsten und höchster Qualität, aber langsam und teuer. Vermeiden Sie wenn möglich.

-

LLM-basierte Bewertung: Schnell und flexibel, skalierbar und geeignet für komplexe Urteile. Testen Sie zuerst auf Zuverlässigkeit und skalieren Sie dann.

Tipps für LLM-basierte Bewertung

- Haben Sie detaillierte, klare Rubriken: „Die Antwort sollte immer „Acme Inc." im ersten Satz erwähnen. Wenn nicht, wird die Antwort automatisch als „falsch" bewertet."

Ein bestimmter Anwendungsfall oder sogar ein spezifisches Erfolgskriterium für diesen Anwendungsfall könnte mehrere Rubriken für eine ganzheitliche Evaluierung erfordern.

- Empirisch oder spezifisch: Weisen Sie das LLM beispielsweise an, nur „korrekt" oder „falsch" auszugeben, oder urteilen Sie auf einer Skala von 1-5. Rein qualitative Evaluierungen sind schwer schnell und in großem Maßstab zu bewerten.

- Fördern Sie Überlegungen: Bitten Sie das LLM, zuerst zu überlegen, bevor es eine Evaluierungspunktzahl entscheidet, und verwerfen Sie dann die Überlegungen. Dies verbessert die Evaluierungsleistung, besonders für Aufgaben, die komplexe Urteile erfordern.