Usando a Ferramenta de Avaliação

Acessando o Recurso de Avaliação

Para começar com a Ferramenta de Avaliação:

- Abra o Claude Console e navegue até o editor de prompts.

- Após compor seu prompt, procure pela aba 'Evaluate' no topo da tela.

Certifique-se de que seu prompt inclua pelo menos 1-2 variáveis dinâmicas usando a sintaxe de chaves duplas: {{variable}}. Isso é necessário para criar conjuntos de testes de avaliação.

Gerando Prompts

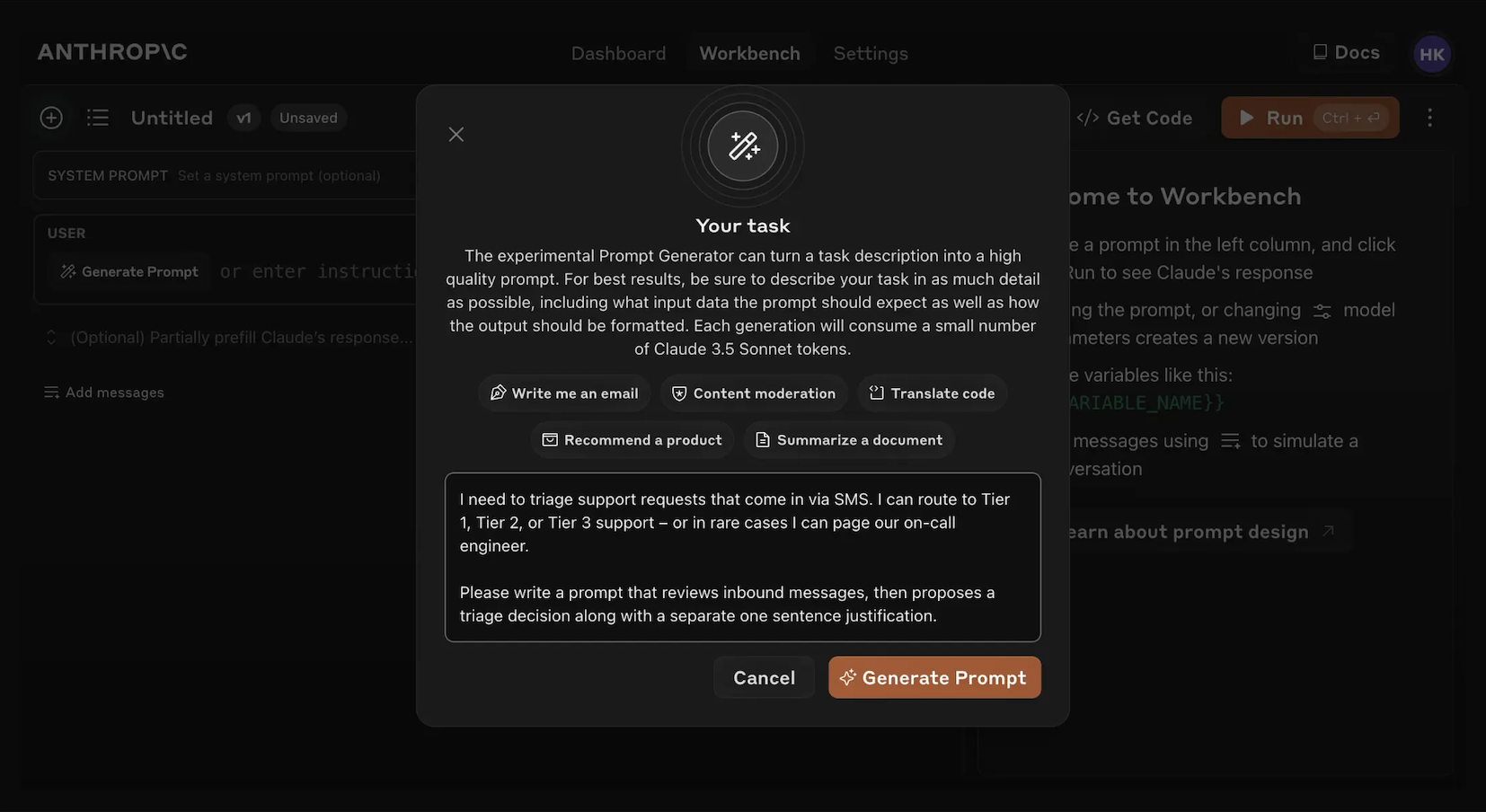

O Console oferece um gerador de prompts integrado alimentado por Claude Opus 4.1:

Clique em 'Generate Prompt'

Clicar na ferramenta auxiliar 'Generate Prompt' abrirá uma janela modal que permite inserir as informações de sua tarefa.

Descreva sua tarefa

Descreva sua tarefa desejada (por exemplo, "Triagem de solicitações de suporte ao cliente recebidas") com o máximo ou mínimo de detalhes que desejar. Quanto mais contexto você incluir, mais Claude poderá personalizar seu prompt gerado para suas necessidades específicas.

Gere seu prompt

Clicar no botão laranja 'Generate Prompt' na parte inferior fará com que Claude gere um prompt de alta qualidade para você. Você pode então melhorar ainda mais esses prompts usando a tela de Avaliação no Console.

Este recurso facilita a criação de prompts com a sintaxe de variável apropriada para avaliação.

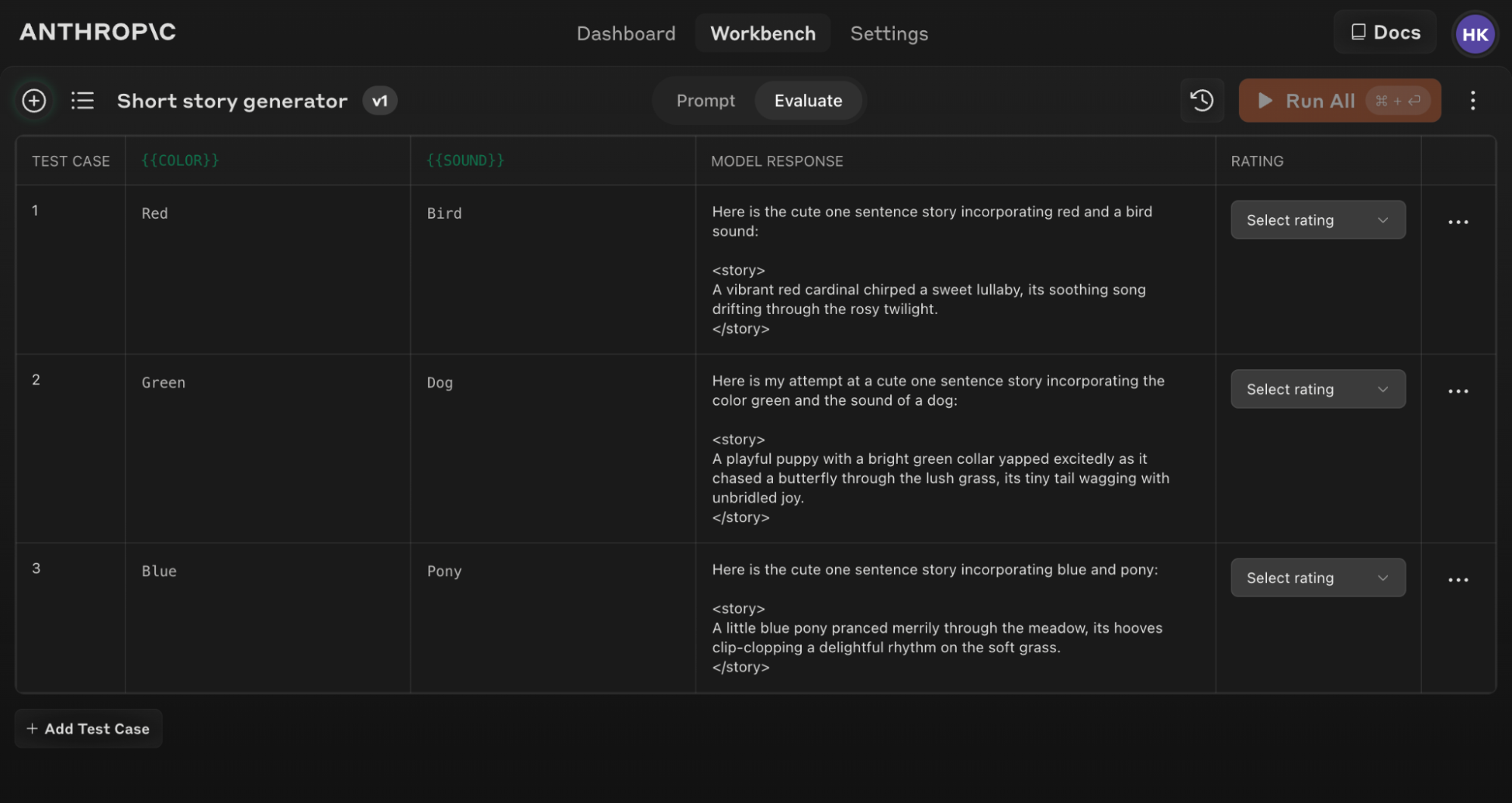

Criando Casos de Teste

Quando você acessa a tela de Avaliação, tem várias opções para criar casos de teste:

- Clique no botão '+ Add Row' na parte inferior esquerda para adicionar manualmente um caso.

- Use o recurso 'Generate Test Case' para que Claude gere automaticamente casos de teste para você.

- Importe casos de teste de um arquivo CSV.

Para usar o recurso 'Generate Test Case':

Clique em 'Generate Test Case'

Claude gerará casos de teste para você, uma linha por vez cada vez que você clicar no botão.

Editar lógica de geração (opcional)

Você também pode editar a lógica de geração de casos de teste clicando na seta suspensa à direita do botão 'Generate Test Case' e depois em 'Show generation logic' no topo da janela Variáveis que aparece. Você pode precisar clicar em `Generate' no canto superior direito desta janela para preencher a lógica de geração inicial.

Editar isso permite que você personalize e ajuste os casos de teste que Claude gera com maior precisão e especificidade.

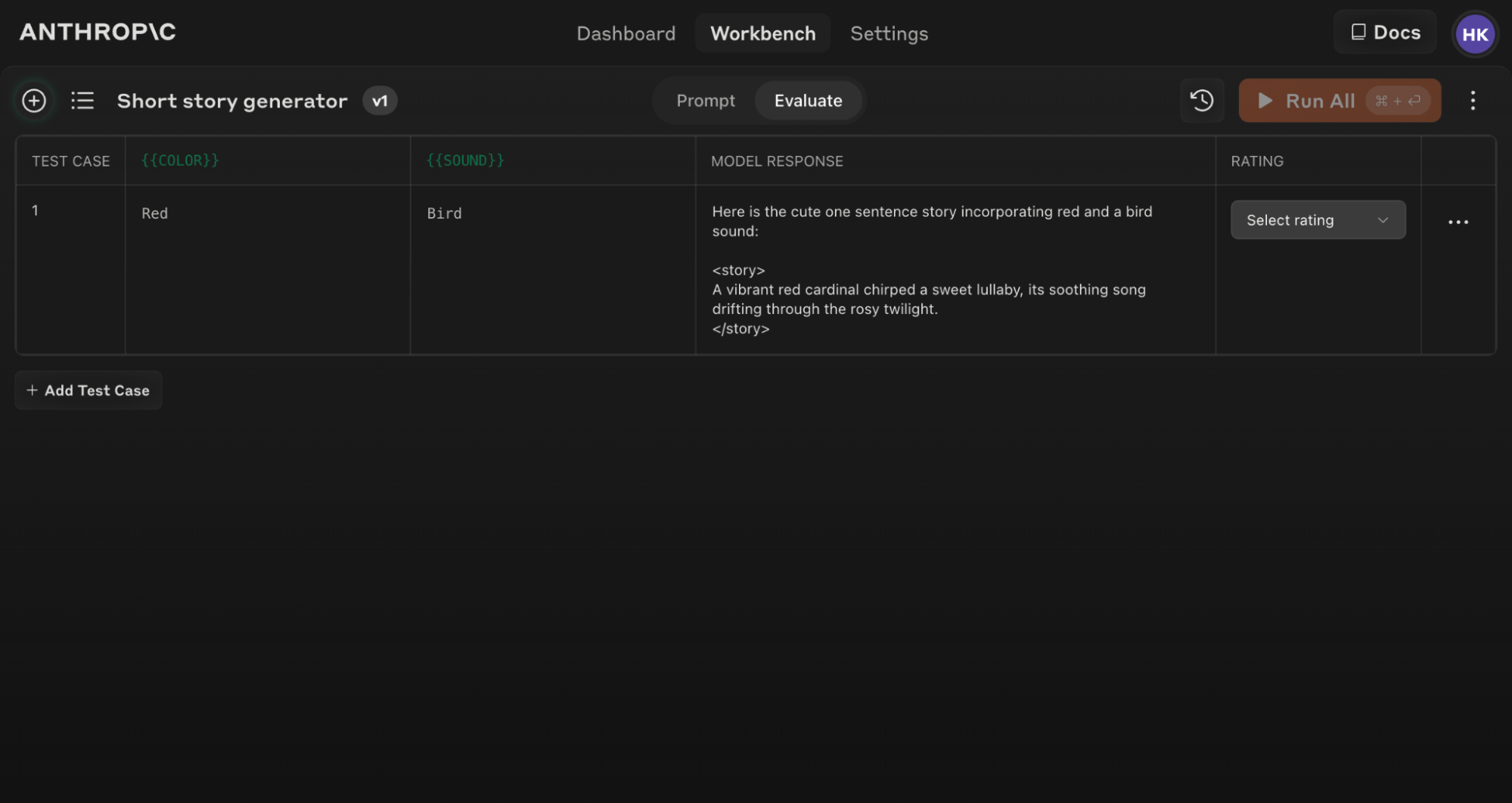

Aqui está um exemplo de uma tela de Avaliação preenchida com vários casos de teste:

Se você atualizar o texto do seu prompt original, pode executar novamente toda a suíte de avaliação contra o novo prompt para ver como as alterações afetam o desempenho em todos os casos de teste.

Dicas para Avaliação Eficaz

Use a ferramenta auxiliar 'Generate a prompt' no Console para criar rapidamente prompts com a sintaxe de variável apropriada para avaliação.

Compreendendo e comparando resultados

A Ferramenta de Avaliação oferece vários recursos para ajudá-lo a refinar seus prompts:

- Comparação lado a lado: Compare as saídas de dois ou mais prompts para ver rapidamente o impacto de suas alterações.

- Classificação de qualidade: Classifique a qualidade da resposta em uma escala de 5 pontos para rastrear melhorias na qualidade da resposta por prompt.

- Versionamento de prompt: Crie novas versões do seu prompt e execute novamente a suíte de testes para iterar rapidamente e melhorar os resultados.

Ao revisar resultados em casos de teste e comparar diferentes versões de prompt, você pode identificar padrões e fazer ajustes informados ao seu prompt de forma mais eficiente.

Comece a avaliar seus prompts hoje para construir aplicações de IA mais robustas com Claude!

Was this page helpful?