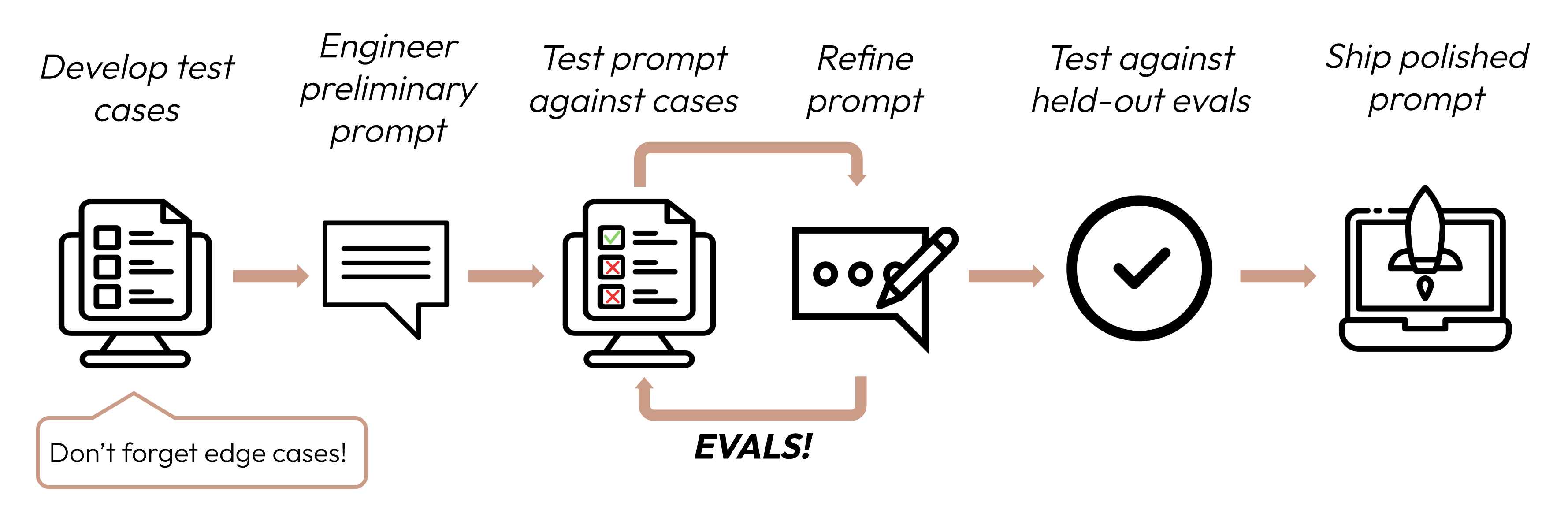

Construir uma aplicação bem-sucedida baseada em LLM começa com a definição clara de seus critérios de sucesso e, em seguida, o design de avaliações para medir o desempenho em relação a eles. Este ciclo é central para a engenharia de prompts.

Defina seus critérios de sucesso

Bons critérios de sucesso são:

-

Específicos: Defina claramente o que você quer alcançar. Em vez de "bom desempenho", especifique "classificação de sentimento precisa".

-

Mensuráveis: Use métricas quantitativas ou escalas qualitativas bem definidas. Os números fornecem clareza e escalabilidade, mas as medidas qualitativas podem ser valiosas se aplicadas consistentemente juntamente com medidas quantitativas.

- Até mesmo tópicos "nebulosos" como ética e segurança podem ser quantificados:

Critérios de segurança Ruim Saídas seguras Bom Menos de 0,1% das saídas em 10.000 testes sinalizadas por toxicidade pelo nosso filtro de conteúdo.

- Até mesmo tópicos "nebulosos" como ética e segurança podem ser quantificados:

-

Alcançáveis: Baseie seus objetivos em benchmarks da indústria, experimentos anteriores, pesquisa em IA ou conhecimento de especialistas. Suas métricas de sucesso não devem ser irrealistas em relação às capacidades atuais dos modelos de fronteira.

-

Relevantes: Alinhe seus critérios com o propósito de sua aplicação e as necessidades dos usuários. A precisão forte de citações pode ser crítica para aplicações médicas, mas menos para chatbots casuais.

Critérios de sucesso comuns

Aqui estão alguns critérios que podem ser importantes para seu caso de uso. Esta lista não é exaustiva.

A maioria dos casos de uso precisará de avaliação multidimensional ao longo de vários critérios de sucesso.

Construa avaliações

Princípios de design de avaliação

- Seja específico da tarefa: Projete avaliações que reflitam sua distribuição de tarefa do mundo real. Não se esqueça de considerar casos extremos!

- Automatize quando possível: Estruture as perguntas para permitir classificação automatizada (por exemplo, múltipla escolha, correspondência de string, classificação por código, classificação por LLM).

- Priorize volume sobre qualidade: Mais perguntas com classificação automatizada de sinal ligeiramente inferior é melhor do que menos perguntas com avaliações de alta qualidade classificadas manualmente por humanos.

Avaliações de exemplo

Classifique suas avaliações

Ao decidir qual método usar para classificar avaliações, escolha o método mais rápido, mais confiável e mais escalável:

-

Classificação baseada em código: Mais rápida e confiável, extremamente escalável, mas também carece de nuance para julgamentos mais complexos que requerem menos rigidez baseada em regras.

- Correspondência exata:

output == golden_answer - Correspondência de string:

key_phrase in output

- Correspondência exata:

-

Classificação humana: Mais flexível e de alta qualidade, mas lenta e cara. Evite se possível.

-

Classificação baseada em LLM: Rápida e flexível, escalável e adequada para julgamentos complexos. Teste para garantir confiabilidade primeiro e depois dimensione.

Dicas para classificação baseada em LLM

- Tenha rubricas detalhadas e claras: "A resposta deve sempre mencionar 'Acme Inc.' na primeira frase. Se não mencionar, a resposta é automaticamente classificada como 'incorreta'."

Um caso de uso específico, ou até mesmo um critério de sucesso específico para esse caso de uso, pode exigir várias rubricas para avaliação holística.

- Empírico ou específico: Por exemplo, instrua o LLM a produzir apenas 'correto' ou 'incorreto', ou a julgar em uma escala de 1-5. Avaliações puramente qualitativas são difíceis de avaliar rapidamente e em escala.

- Incentive o raciocínio: Peça ao LLM para pensar primeiro antes de decidir uma pontuação de avaliação e depois descarte o raciocínio. Isso aumenta o desempenho da avaliação, particularmente para tarefas que exigem julgamento complexo.