Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

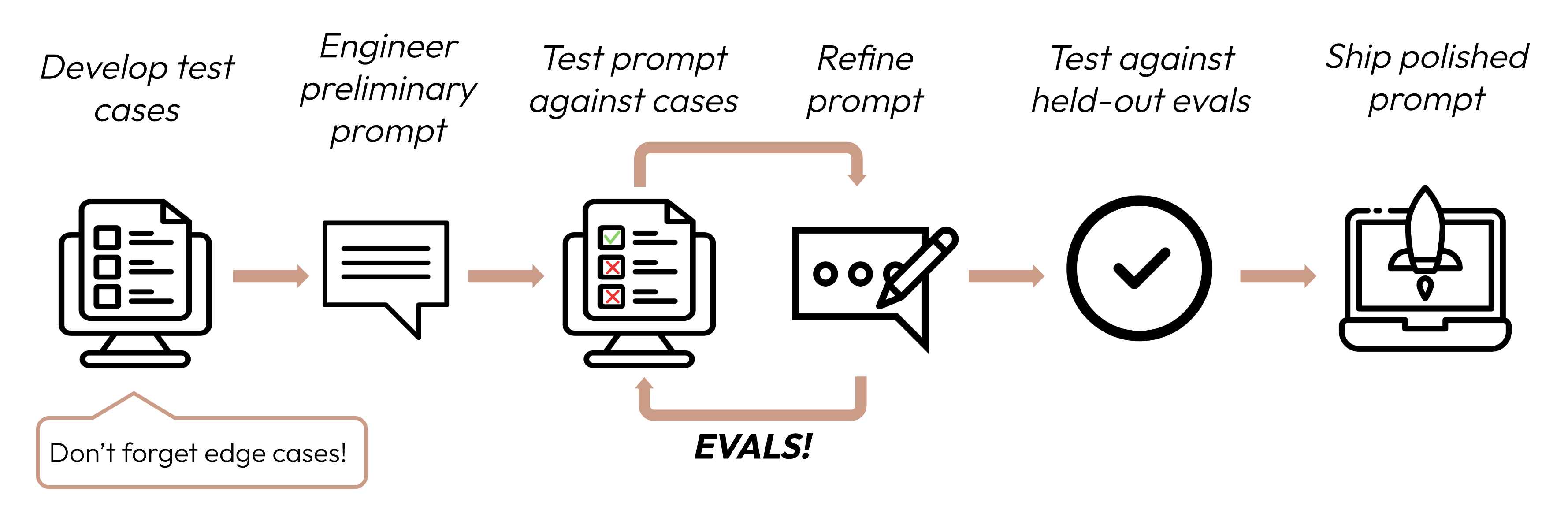

建立成功的基於 LLM 的應用程式始於清楚地定義您的成功標準,然後設計評估來衡量對標準的效能。這個循環是提示工程的核心。

好的成功標準具有以下特點:

具體: 清楚地定義您想要達成的目標。不要說「良好的效能」,而是指定「準確的情感分類」。

可測量: 使用量化指標或定義明確的定性量表。數字提供清晰度和可擴展性,但如果與量化指標一致應用,定性指標也很有價值。

| 安全標準 | |

|---|---|

| 不佳 | 安全輸出 |

| 良好 | 在 10,000 次試驗中,少於 0.1% 的輸出被我們的內容過濾器標記為有毒。 |

可達成: 根據行業基準、先前的實驗、AI 研究或專家知識來設定您的目標。您的成功指標不應該對當前最先進的模型能力不切實際。

相關: 將您的標準與應用程式的目的和用戶需求相一致。強大的引用準確性對於醫療應用可能至關重要,但對於隨意聊天機器人則不那麼重要。

以下是一些可能對您的用例很重要的標準。此列表並非詳盡無遺。

大多數用例將需要沿著多個成功標準進行多維評估。

在決定使用哪種方法來評分評估時,選擇最快、最可靠、最可擴展的方法:

基於代碼的評分: 最快且最可靠,極其可擴展,但對於需要較少基於規則的嚴格性的更複雜判斷缺乏細微差別。

output == golden_answerkey_phrase in output人工評分: 最靈活和高質量,但速度慢且成本高。盡可能避免。

基於 LLM 的評分: 快速且靈活,可擴展且適合複雜判斷。首先測試以確保可靠性,然後擴展。

Was this page helpful?