Tentukan kriteria kesuksesan dan bangun evaluasi

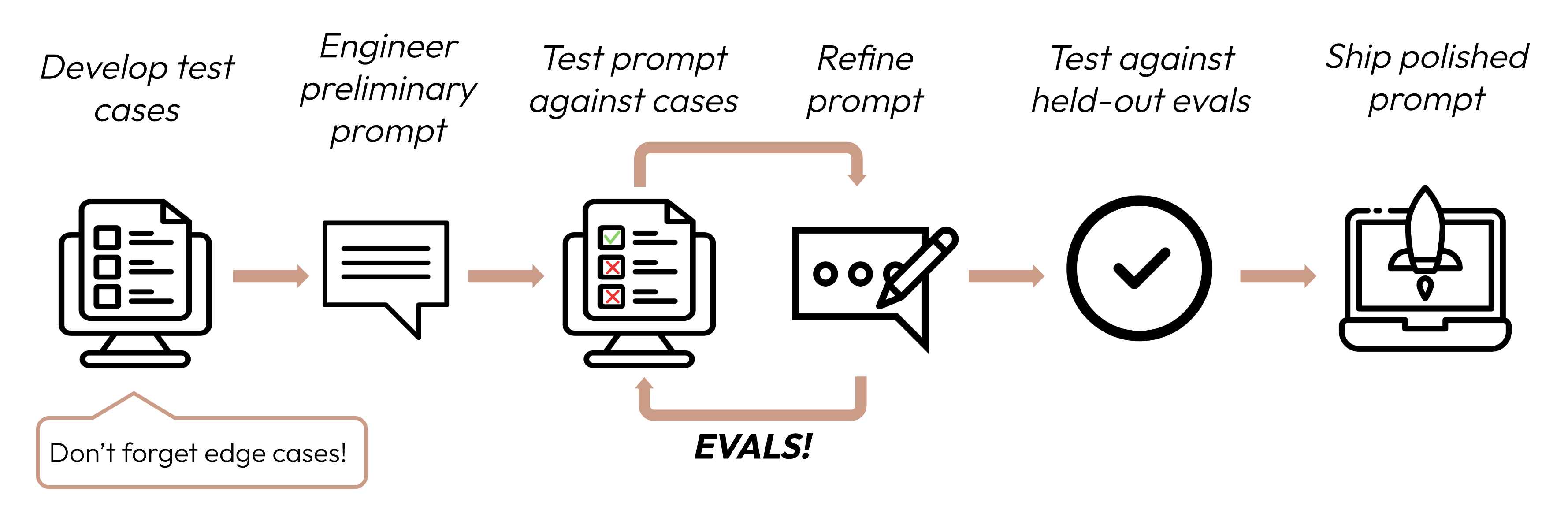

Membangun aplikasi berbasis LLM yang sukses dimulai dengan mendefinisikan kriteria kesuksesan Anda dengan jelas dan kemudian merancang evaluasi untuk mengukur kinerja terhadap kriteria tersebut. Siklus ini adalah inti dari prompt engineering.

Tentukan kriteria kesuksesan Anda

Kriteria kesuksesan yang baik adalah:

-

Spesifik: Tentukan dengan jelas apa yang ingin Anda capai. Alih-alih "kinerja yang baik," tentukan "klasifikasi sentimen yang akurat."

-

Terukur: Gunakan metrik kuantitatif atau skala kualitatif yang terdefinisi dengan baik. Angka memberikan kejelasan dan skalabilitas, tetapi ukuran kualitatif dapat berharga jika diterapkan secara konsisten bersama dengan ukuran kuantitatif.

- Bahkan topik yang "kabur" seperti etika dan keselamatan dapat dikuantifikasi:

Kriteria Keselamatan Buruk Output yang aman Baik Kurang dari 0,1% dari output dari 10.000 uji coba ditandai untuk toksisitas oleh filter konten kami.

- Bahkan topik yang "kabur" seperti etika dan keselamatan dapat dikuantifikasi:

-

Dapat Dicapai: Dasarkan target Anda pada benchmark industri, eksperimen sebelumnya, penelitian AI, atau pengetahuan ahli. Metrik kesuksesan Anda tidak boleh tidak realistis terhadap kemampuan model frontier saat ini.

-

Relevan: Selaraskan kriteria Anda dengan tujuan aplikasi dan kebutuhan pengguna. Akurasi kutipan yang kuat mungkin penting untuk aplikasi medis tetapi kurang penting untuk chatbot santai.

Kriteria kesuksesan umum

Berikut adalah beberapa kriteria yang mungkin penting untuk use case Anda. Daftar ini tidak lengkap.

Sebagian besar use case akan memerlukan evaluasi multidimensional di sepanjang beberapa kriteria kesuksesan.

Bangun evaluasi

Prinsip desain eval

- Spesifik untuk tugas: Desain eval yang mencerminkan distribusi tugas dunia nyata Anda. Jangan lupa untuk mempertimbangkan edge case!

- Otomatisasi jika memungkinkan: Struktur pertanyaan untuk memungkinkan penilaian otomatis (misalnya, pilihan ganda, string match, code-graded, LLM-graded).

- Prioritaskan volume daripada kualitas: Lebih banyak pertanyaan dengan penilaian otomatis sinyal yang sedikit lebih rendah lebih baik daripada lebih sedikit pertanyaan dengan eval hand-graded berkualitas tinggi.

Contoh eval

Nilai evaluasi Anda

Saat memutuskan metode mana yang akan digunakan untuk menilai eval, pilih metode yang tercepat, paling andal, dan paling dapat diskalakan:

-

Penilaian berbasis kode: Tercepat dan paling andal, sangat dapat diskalakan, tetapi juga kurang bernuansa untuk penilaian yang lebih kompleks yang memerlukan fleksibilitas berbasis aturan yang lebih rendah.

- Exact match:

output == golden_answer - String match:

key_phrase in output

- Exact match:

-

Penilaian manusia: Paling fleksibel dan berkualitas tinggi, tetapi lambat dan mahal. Hindari jika memungkinkan.

-

Penilaian berbasis LLM: Cepat dan fleksibel, dapat diskalakan dan cocok untuk penilaian yang kompleks. Uji untuk memastikan keandalan terlebih dahulu kemudian skalakan.

Tips untuk penilaian berbasis LLM

- Miliki rubrik yang terperinci dan jelas: "Jawaban harus selalu menyebutkan 'Acme Inc.' di kalimat pertama. Jika tidak, jawaban secara otomatis dinilai sebagai 'tidak benar.'"

Use case tertentu, atau bahkan kriteria kesuksesan spesifik untuk use case itu, mungkin memerlukan beberapa rubrik untuk evaluasi holistik.

- Empiris atau spesifik: Misalnya, instruksikan LLM untuk hanya mengeluarkan 'benar' atau 'salah', atau untuk menilai dari skala 1-5. Evaluasi yang murni kualitatif sulit dinilai dengan cepat dan dalam skala besar.

- Dorong penalaran: Minta LLM untuk berpikir terlebih dahulu sebelum memutuskan skor evaluasi, kemudian buang penalarannya. Ini meningkatkan kinerja evaluasi, terutama untuk tugas yang memerlukan penilaian yang kompleks.

Langkah berikutnya

Brainstorm kriteria kesuksesan untuk use case Anda dengan Claude di claude.ai.

Tip: Masukkan halaman ini ke dalam chat sebagai panduan untuk Claude!

Lebih banyak contoh kode eval yang dinilai oleh manusia, kode, dan LLM.

Was this page helpful?