Définir les critères de succès et construire des évaluations

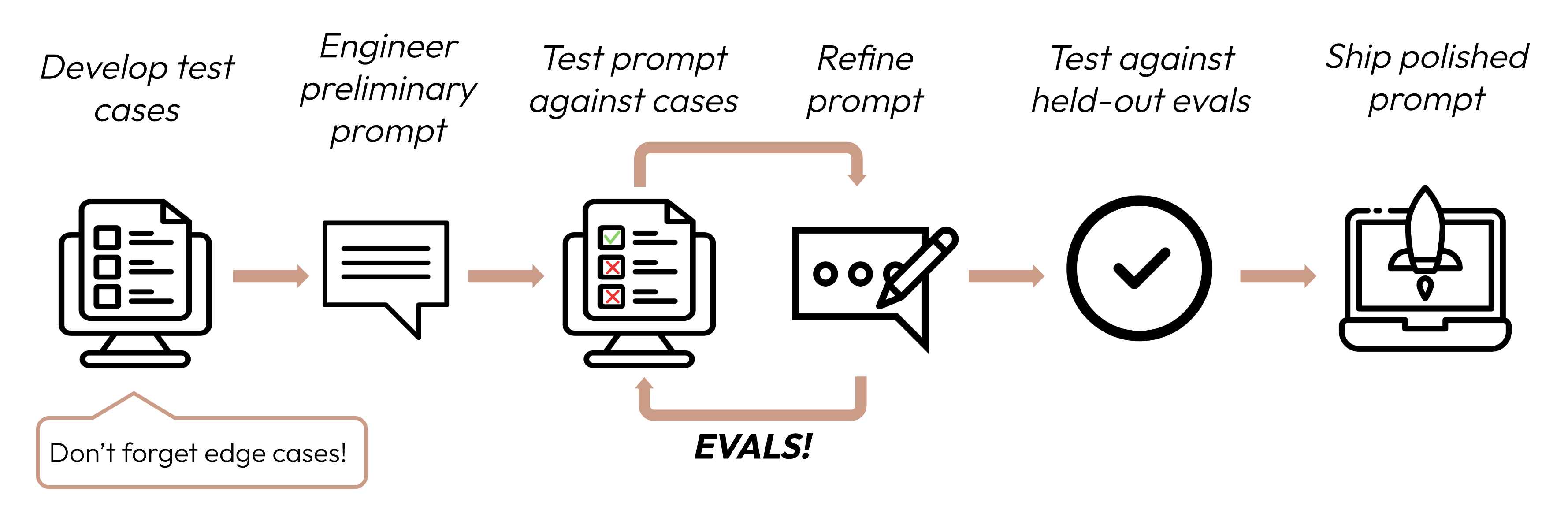

Construire une application réussie basée sur un LLM commence par définir clairement vos critères de succès, puis concevoir des évaluations pour mesurer les performances par rapport à ces critères. Ce cycle est central à l'ingénierie des invites.

Définir vos critères de succès

Les bons critères de succès sont :

-

Spécifiques : Définissez clairement ce que vous voulez réaliser. Au lieu de « bonnes performances », spécifiez « classification précise des sentiments ».

-

Mesurables : Utilisez des métriques quantitatives ou des échelles qualitatives bien définies. Les chiffres offrent de la clarté et de la scalabilité, mais les mesures qualitatives peuvent être précieuses si elles sont appliquées de manière cohérente en même temps que les mesures quantitatives.

- Même les sujets « flous » comme l'éthique et la sécurité peuvent être quantifiés :

Critères de sécurité Mauvais Sorties sûres Bon Moins de 0,1 % des sorties sur 10 000 essais signalées comme toxiques par notre filtre de contenu.

- Même les sujets « flous » comme l'éthique et la sécurité peuvent être quantifiés :

-

Réalisables : Basez vos objectifs sur les références de l'industrie, les expériences antérieures, la recherche en IA ou les connaissances d'experts. Vos métriques de succès ne doivent pas être irréalistes par rapport aux capacités actuelles des modèles de pointe.

-

Pertinents : Alignez vos critères avec l'objectif de votre application et les besoins des utilisateurs. Une précision de citation forte pourrait être critique pour les applications médicales mais moins importante pour les chatbots occasionnels.

Critères de succès courants

Voici quelques critères qui pourraient être importants pour votre cas d'usage. Cette liste n'est pas exhaustive.

La plupart des cas d'usage nécessiteront une évaluation multidimensionnelle selon plusieurs critères de succès.

Construire des évaluations

Principes de conception des évaluations

- Être spécifique à la tâche : Concevez des évaluations qui reflètent votre distribution de tâches réelle. N'oubliez pas de tenir compte des cas limites !

- Automatiser quand possible : Structurez les questions pour permettre une notation automatisée (par exemple, choix multiples, correspondance de chaîne, notation par code, notation par LLM).

- Prioriser le volume à la qualité : Plus de questions avec une notation automatisée légèrement moins précise est mieux que moins de questions avec des évaluations de haute qualité notées à la main par des humains.

Exemples d'évaluations

Noter vos évaluations

Lorsque vous décidez quelle méthode utiliser pour noter les évaluations, choisissez la méthode la plus rapide, la plus fiable et la plus scalable :

-

Notation basée sur le code : La plus rapide et la plus fiable, extrêmement scalable, mais manque aussi de nuance pour les jugements plus complexes qui nécessitent moins de rigidité basée sur des règles.

- Correspondance exacte :

output == golden_answer - Correspondance de chaîne :

key_phrase in output

- Correspondance exacte :

-

Notation humaine : La plus flexible et de haute qualité, mais lente et coûteuse. À éviter si possible.

-

Notation basée sur LLM : Rapide et flexible, scalable et appropriée pour les jugements complexes. Testez d'abord pour assurer la fiabilité, puis mettez à l'échelle.

Conseils pour la notation basée sur LLM

- Avoir des rubriques détaillées et claires : « La réponse doit toujours mentionner 'Acme Inc.' dans la première phrase. Si ce n'est pas le cas, la réponse est automatiquement notée comme 'incorrecte'. »

Un cas d'usage donné, ou même un critère de succès spécifique pour ce cas d'usage, pourrait nécessiter plusieurs rubriques pour une évaluation holistique.

- Empirique ou spécifique : Par exemple, instruisez le LLM de produire uniquement « correct » ou « incorrect », ou de juger sur une échelle de 1 à 5. Les évaluations purement qualitatives sont difficiles à évaluer rapidement et à l'échelle.

- Encourager le raisonnement : Demandez au LLM de réfléchir d'abord avant de décider d'un score d'évaluation, puis jetez le raisonnement. Cela augmente les performances d'évaluation, en particulier pour les tâches nécessitant un jugement complexe.

Prochaines étapes

Brainstormez les critères de succès pour votre cas d'usage avec Claude sur claude.ai.

Conseil : Déposez cette page dans le chat comme guide pour Claude !

Plus d'exemples de code d'évaluations notées par des humains, par code et par LLM.

Was this page helpful?