Define success criteria and build evaluations

Construir una aplicación exitosa basada en LLM comienza con definir claramente tus criterios de éxito y luego diseñar evaluaciones para medir el rendimiento contra ellos. Este ciclo es central para la ingeniería de prompts.

Define your success criteria

Los buenos criterios de éxito son:

-

Específicos: Define claramente qué quieres lograr. En lugar de "buen rendimiento", especifica "clasificación precisa del sentimiento".

-

Medibles: Usa métricas cuantitativas o escalas cualitativas bien definidas. Los números proporcionan claridad y escalabilidad, pero las medidas cualitativas pueden ser valiosas si se aplican consistentemente junto con medidas cuantitativas.

- Incluso temas "borrosos" como la ética y la seguridad pueden cuantificarse:

Criterios de seguridad Malo Salidas seguras Bueno Menos del 0.1% de salidas de 10,000 pruebas marcadas por toxicidad por nuestro filtro de contenido.

- Incluso temas "borrosos" como la ética y la seguridad pueden cuantificarse:

-

Alcanzables: Basa tus objetivos en puntos de referencia de la industria, experimentos previos, investigación en IA o conocimiento de expertos. Tus métricas de éxito no deben ser irrealistas para las capacidades actuales de los modelos de frontera.

-

Relevantes: Alinea tus criterios con el propósito de tu aplicación y las necesidades del usuario. La precisión fuerte de las citas podría ser crítica para aplicaciones médicas pero menos para chatbots casuales.

Common success criteria

Aquí hay algunos criterios que podrían ser importantes para tu caso de uso. Esta lista no es exhaustiva.

La mayoría de los casos de uso necesitarán evaluación multidimensional a lo largo de varios criterios de éxito.

Build evaluations

Eval design principles

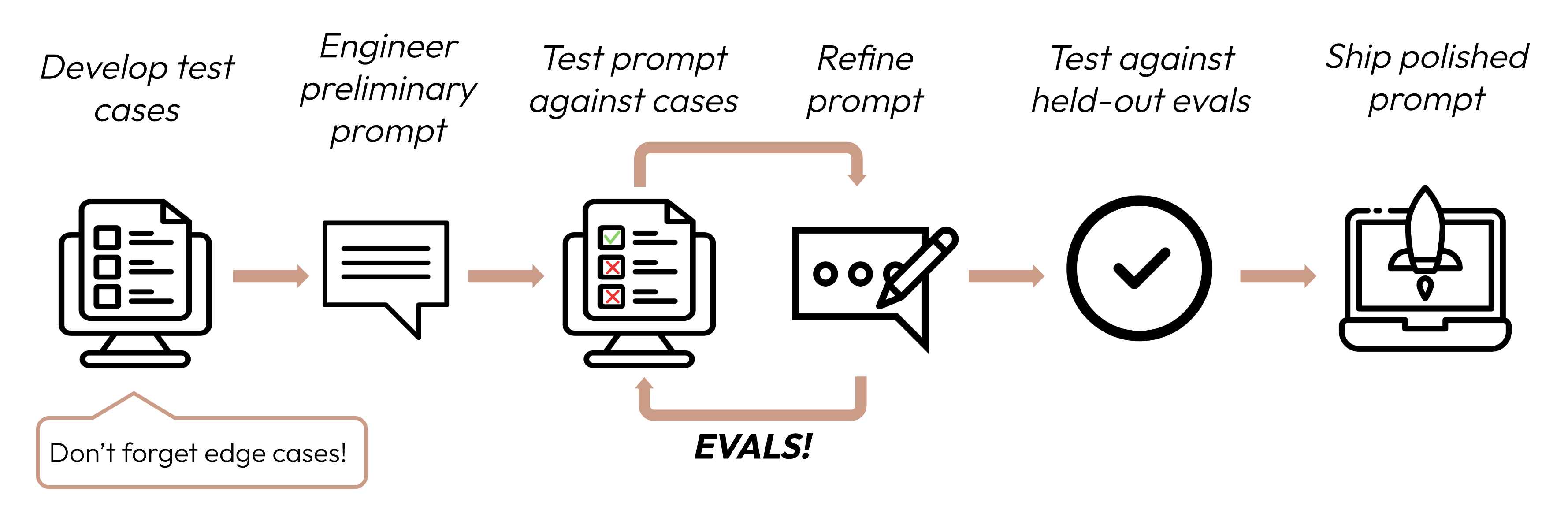

- Sé específico de la tarea: Diseña evaluaciones que reflejen tu distribución de tareas del mundo real. ¡No olvides factorizar casos extremos!

- Automatiza cuando sea posible: Estructura preguntas para permitir calificación automatizada (por ejemplo, opción múltiple, coincidencia de cadena, calificación de código, calificación de LLM).

- Prioriza volumen sobre calidad: Más preguntas con calificación automatizada de señal ligeramente más baja es mejor que menos preguntas con evaluaciones de alta calidad calificadas manualmente por humanos.

Example evals

Grade your evaluations

Al decidir qué método usar para calificar evaluaciones, elige el método más rápido, más confiable y más escalable:

-

Calificación basada en código: La más rápida y confiable, extremadamente escalable, pero también carece de matices para juicios más complejos que requieren menos rigidez basada en reglas.

- Coincidencia exacta:

output == golden_answer - Coincidencia de cadena:

key_phrase in output

- Coincidencia exacta:

-

Calificación humana: La más flexible y de alta calidad, pero lenta y cara. Evita si es posible.

-

Calificación basada en LLM: Rápida y flexible, escalable y adecuada para juicios complejos. Prueba para asegurar confiabilidad primero y luego escala.

Tips for LLM-based grading

- Ten rúbricas detalladas y claras: "La respuesta siempre debe mencionar 'Acme Inc.' en la primera oración. Si no lo hace, la respuesta se califica automáticamente como 'incorrecta'."

Un caso de uso dado, o incluso un criterio de éxito específico para ese caso de uso, podría requerir varias rúbricas para una evaluación holística.

- Empírico o específico: Por ejemplo, instruye al LLM para que genere solo 'correcto' o 'incorrecto', o para que juzgue en una escala de 1-5. Las evaluaciones puramente cualitativas son difíciles de evaluar rápidamente y a escala.

- Fomenta el razonamiento: Pide al LLM que piense primero antes de decidir una puntuación de evaluación, y luego descarta el razonamiento. Esto aumenta el rendimiento de la evaluación, particularmente para tareas que requieren juicio complejo.

Next steps

Brainstorm success criteria for your use case with Claude on claude.ai.

Tip: Drop this page into the chat as guidance for Claude!

More code examples of human-, code-, and LLM-graded evals.

Was this page helpful?