Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

Loading...

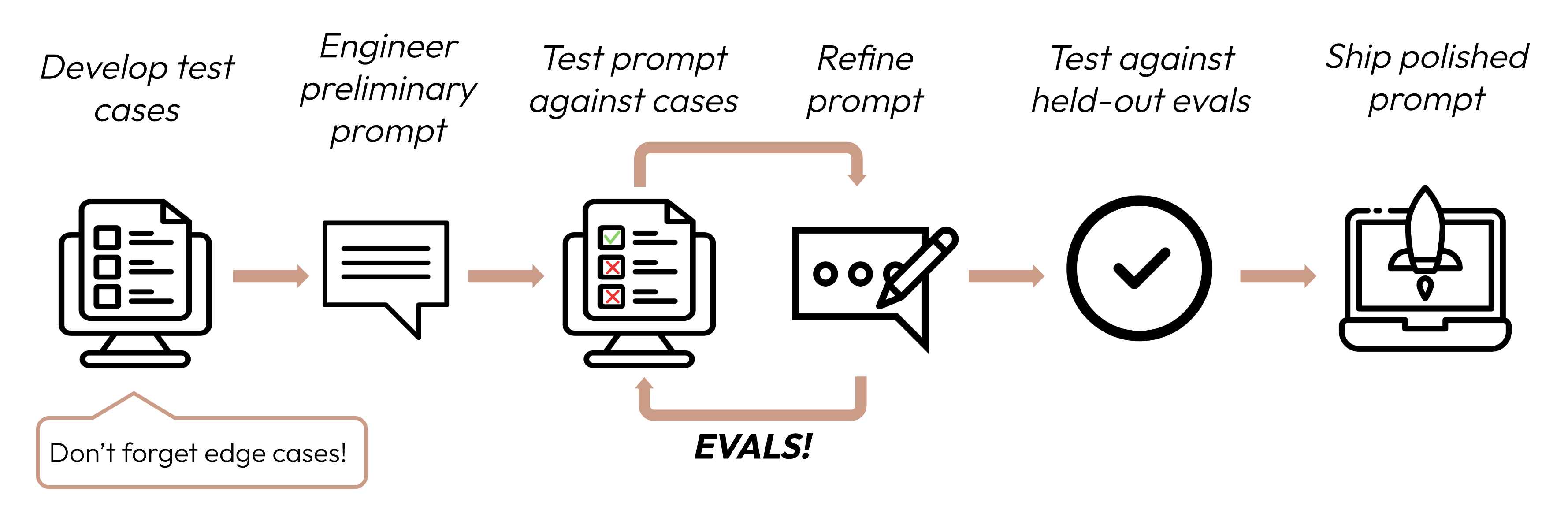

构建成功的基于LLM的应用始于清晰地定义您的成功标准,然后设计评估来衡量性能。这个循环是提示工程的核心。

好的成功标准应该具有以下特点:

具体性: 清楚地定义您想要实现的目标。不要说"良好的性能",而应该指定"准确的情感分类"。

可测量性: 使用定量指标或定义明确的定性量表。数字提供清晰度和可扩展性,但定性措施如果与定量措施一起一致应用,也可能很有价值。

| 安全标准 | |

|---|---|

| 差 | 安全输出 |

| 好 | 在10,000次试验中,少于0.1%的输出被我们的内容过滤器标记为有毒。 |

可实现性: 将您的目标基于行业基准、先前的实验、AI研究或专家知识。您的成功指标不应该对当前前沿模型的能力不切实际。

相关性: 将您的标准与应用的目的和用户需求保持一致。强大的引用准确性对医疗应用可能至关重要,但对随意聊天机器人则不那么重要。

以下是一些可能对您的用例很重要的标准。此列表并非详尽无遗。

大多数用例需要沿着多个成功标准进行多维评估。

在决定使用哪种方法来评分评估时,选择最快、最可靠、最可扩展的方法:

基于代码的评分: 最快且最可靠,极其可扩展,但对于需要较少基于规则的刚性的更复杂判断缺乏细微差别。

output == golden_answerkey_phrase in output人工评分: 最灵活和高质量,但速度慢且成本高。如果可能,应避免。

基于LLM的评分: 快速灵活,可扩展且适合复杂判断。先测试以确保可靠性,然后扩展。

Was this page helpful?